为什么正则化能够解决过拟合问题一. 正则化的解释二. 拉格朗日乘数法三. 正则化是怎么解决过拟合问题的1. 引出范数1.1 L_0范数1.2 L_1范数1.3 L_2范数2. L_2范式正则项如何解决过拟合问题2.1 公式推导2.2 图像推导[^...

”ar ens fl flow IN io low ng ns OR ove over ow reg regular te ten tensor tensorflow ul w 正则 正则化 过拟合“ 的搜索结果

原理解析-过拟合与正则化什么是过拟合线性回归中,正则化一般怎么实现?L0正则化解析L1正则化解析L1正则化为什么可以防止过拟合?为什么L1正则化会使得参数稀疏,一部分参数的系数会变为0?L2正则化解析L2正则化为...

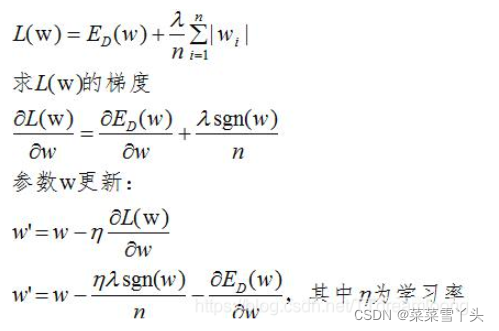

L2正则化训练的原理:在Loss中加入(乘以系数λ的)参数w的平方和,这样训练过程中就会抑制w的值,w的(绝对)值小,模型复杂度低,曲线平滑,过拟合程度低(奥卡姆剃刀),参考公式如下图: (正则化是不阻碍你去...

该文档包含了过拟合产生的原因,解决方法,以及为什么引入正则化,L1和L2的区别、L1为什么产生稀疏矩阵等等,欢迎下载

与其他机器学习技术结合使用,如线性回归和逻辑回归,正则化技术可以有效地减少过拟合问题,并增加模型的普适性和稳健性。L2正则化是以参数权重二次方之和作为惩罚项,可以使得参数权重变得更加平滑,从而缓解过度...

正则化方法:防止过拟合,提高泛化能力 转载文章:https://www.cnblogs.com/alexanderkun/p/6922428.html 在训练数据不够多时,或者overtraining时,常常会导致overfitting(过拟合)。其直观的表现如下图所示,...

本文介绍了如何避免神经网络过拟合以及6种常用的正则化方法。

在上次的线性回归就有提到正则化,下面就来更具体地介绍什么是正则化。 1.为什么要正则化 2.正则化的作用 3.

过拟合问题及其解决方案和原理

为什么正则化可以防止过拟合? 整理并翻译自吴恩达深度系列视频教程 https://mooc.study.163.com/learn/2001281003?tid=2001391036#/learn/content?type=detail&id=2001702116&amp...

一、过拟合监督机器学习问题无非就是“minimizeyour error while regularizing your parameters”,也就是在规则化参数的同时最小化误差。最小化误差是为了让我们的模型拟合我们的训练数据,而规则化参数是防止我们...

一种叫过拟合(over-fitting )另外一种叫欠拟合(under-fitting)。 首先谈谈什么是过拟合呢?什么又是欠拟合呢?网上很直接的图片理解如下: 所谓过拟合(over-fitting)其实就是所建的机器学习模型或者是深度...

什么是L1正则化 在机器学习任务中,对于一个参数模型,优化参数时一定伴随着损失函数的建立与优化。 通常不加入L1正则化的损失函数为 JL1(w)=L(w) J_{L1}(w) = L(w) JL1(w)=L(w) 加入L1正则化的损失函数为 JL1(w)=...

过拟合几乎可以说是每个深度学习网络的噩梦,当模型深度较大时,若不加以处理,几乎都会碰上。出现过拟合的特点是:看起来效果很好(在训练集上),而实际上已经废了(在测试集或验证集上)。因此如何在训练时避免过...

1 过拟合 过拟合——过多的变量(特征),同时只有非常少的训练数据,会导致出现过度拟合的问题 1 、方法一:尽量减少选取变量的数量 2、正则化 正则化中我们将保留所有的特征变量,但是会减小特征变量的数量级 ...

通过这篇博客,你将清晰的明白什么是过拟合、正则化、惩罚函数。这个专栏名为白话机器学习中数学学习笔记,主要是用来分享一下我在 机器学习中的学习笔记及一些感悟,也希望对你的学习有帮助哦!感兴趣的小伙伴欢迎...

一、出现过拟合的原因 在训练数据不够多时,或者overtraining时,常常会导致overfitting(过拟合)。其直观的表现如下图所示,随着训练过程的进行,模型复杂度增加,在training data上的error渐渐减小,但是在验证...

推荐文章

- php 上传图片 缩略图,PHP 图片上传类 缩略图-程序员宅基地

- scrapy爬虫框架_3.6.1 scrapy 的版本-程序员宅基地

- 微信支付——统一下单——java_小程序统一下单接口-程序员宅基地

- (已解决)报错 ValueError: Tensor conversion requested dtype float32 for Tensor with dtype resource-程序员宅基地

- 记录el-table树形数据,默认展开折叠按钮失效_eltable一刷新展开的子节点展开按钮消失-程序员宅基地

- 设计模式复习-桥接模式_csdn天使也掉毛-程序员宅基地

- CodeForces - 894A-QAQ(思维)_"qaq\" is a word to denote an expression of crying-程序员宅基地

- java毕业生设计移动学习网站计算机源码+系统+mysql+调试部署+lw-程序员宅基地

- 14种神笔记方法,只需选择1招,让你的学习和工作效率提高100倍!_1秒笔记 高级-程序员宅基地

- 最新java毕业论文英文参考文献_计算机毕业论文javaweb英文文献-程序员宅基地